L'AI nelle organizzazioni si governa. O si subisce.

La produttività che gli strumenti AI portano è reale. I rischi che introducono, data leakage, dipendenza dai provider, esposizione normativa, lo sono altrettanto. La risposta non è rallentare l’adozione: è architetturarla dall’inizio, per design.

Ogni giorno i dati aziendali raggiungono provider AI che non conosci.

I team usano ChatGPT, Copilot, Claude e decine di altri strumenti AI cloud per lavorare più velocemente. In molti casi, i prompt che inviano contengono informazioni riservate: bozze di contratti, dati cliente, comunicazioni strategiche, knowhow operativo.

Il provider AI riceve quei dati. L’organizzazione perde il controllo su di essi, e spesso non lo sa. Non è un rischio futuro. È già in corso, in quasi ogni azienda che ha adottato strumenti AI cloud.

38%

Dipendenti che condividono informazioni riservate con strumenti AI senza il permesso del datore di lavoro83%

organizzazioni che non hanno controlli automatizzati per impedire ai dati sensibili di raggiungere strumenti AI pubblici34%

organizzazioni con incidenti di sicurezza legati all'uso di app AI

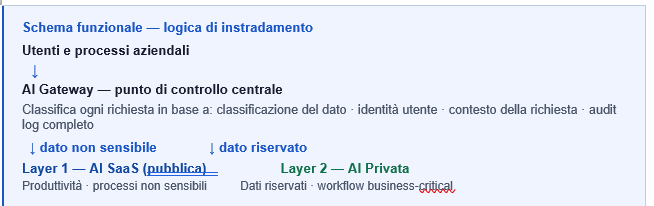

Due layer, un gateway. La protezione è nell'architettura.

L’approccio separa strutturalmente i processi che possono usare AI pubblica da quelli che richiedono un ambiente privato e auditabile. Un gateway centrale gestisce l’instradamento automatico di ogni richiesta.

Ogni dato nel layer che gli appartiene

AI saasProduttività e processi non sensibili Redazione documenti, email, sintesi meeting, Raccolta requisiti, brainstorming, ricerca, Assistenza alla scrittura e revisione del codice, Contenuti marketing, comunicazione esterna.

AI privatiDati riservati e workflow business-critical Anagrafiche clienti, contratti, storico CRM, Automazioni operative e workflow interni, Knowledge base aziendale proprietaria (RAG), Agenti interni con auditabilità completa.

Dall'assessment all'architettura operativa

Il percorso si struttura in quattro fasi, adattabili alla maturità AI dell’organizzazione e all’infrastruttura esistente.

Chi ha questo problema oggi

Azienda B2B con 200+ dipendenti, Copilot attivo I team commerciali usano Copilot per sintetizzare email e redigere offerte. I documenti allegati contengono pricing riservato, clausole contrattuali, dati cliente. L’organizzazione non ha visibilità su quali dati vengono inviati a Microsoft e come vengono trattati. L’architettura a due layer separa l’uso produttivo dall’esposizione dei dati sensibili, senza disabilitare gli strumenti.

Organizzazione in settore regolamento (finance, healtcare, legal) I processi operativi trattano dati soggetti a GDPR, normative di settore o accordi di riservatezza con clienti enterprise. L’adozione AI è bloccata per ragioni di compliance. La Governed AI Architecture abilita l’adozione con un’architettura che rende la compliance documentabile e verificabile — non una promessa del provider, ma una garanzia strutturale.

Competenze e specializzazioni

Competenze e specializzazioni

Mobile

Web App

Data / AI

DevSecOps

IBM i

Richiedi un assessment iniziale

Entra in contatto con i nostri esperti